基于Llama3 70B和405B后训练的混合推理模型,按官方说主要特色为没有公司强加的伦理道德,在争议话题上的拒绝率要更低,并且角色扮演和创意性写作的表现也更好

HuggingFace:https://huggingface.co/collections/NousResearch/hermes-4-collection-68a731bfd452e20816725728

官方对话网页:https://chat.nousresearch.com/login

官方对话网页:https://chat.nousresearch.com/login

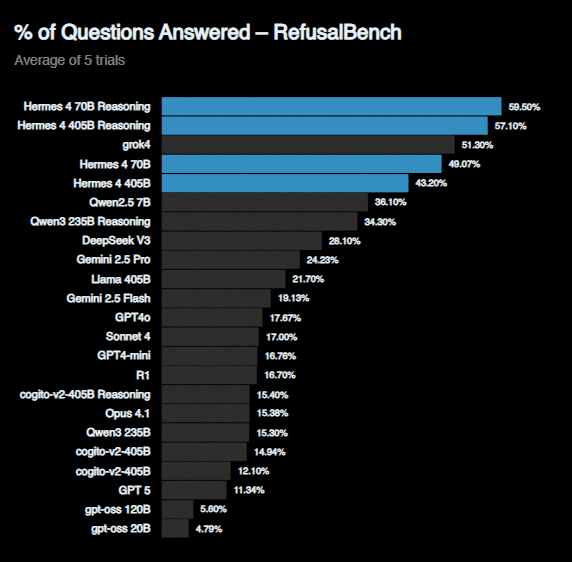

思考模式下在 RefusalBench 上第一,非思考模式仅次于Grok4

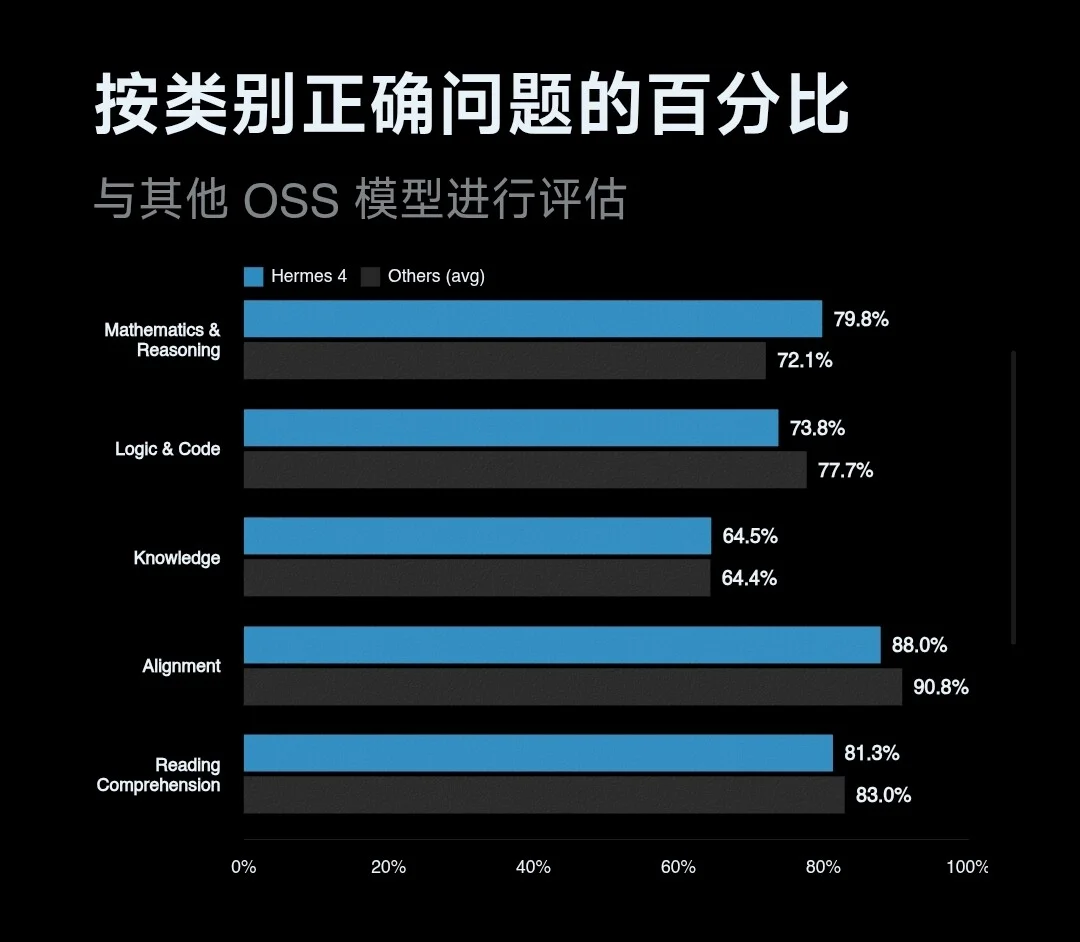

不过智力跑分和其他开源模型的平均分对比就很会玩

不过智力跑分和其他开源模型的平均分对比就很会玩