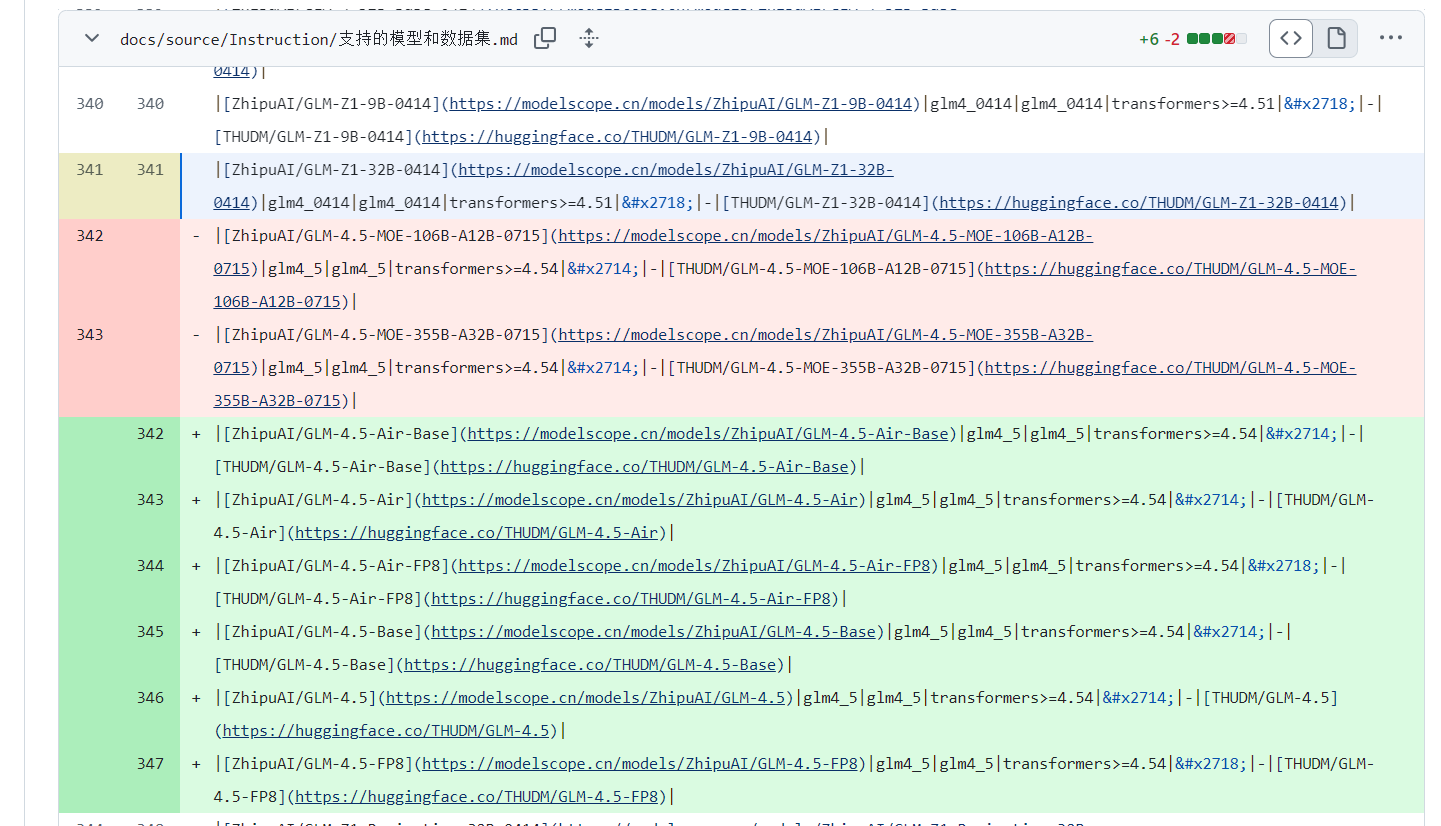

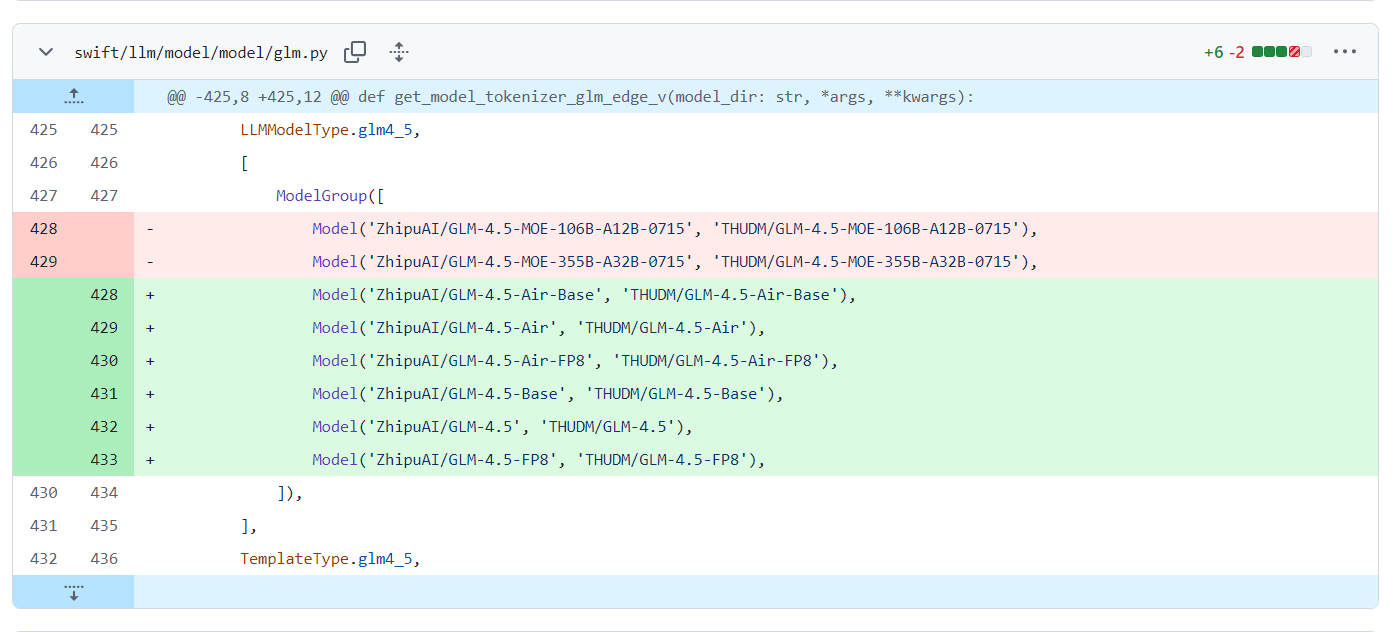

https://github.com/modelscope/ms-swift/commit/a26c6a1369f42cfbd1affa6f92af2514ce1a29e7#diff-56be9fe963a760573f3e2166157222d00c193041a95076d5326b2b7f557a5bf2R341

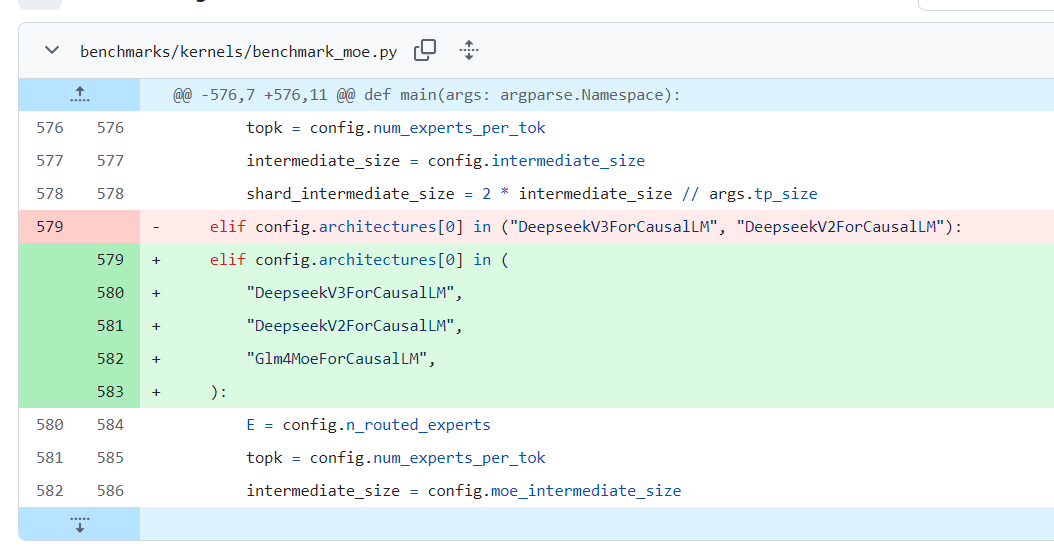

从vllm的commit看出,疑似采用新MoE架构,使用MLA机制

https://github.com/vllm-project/vllm/commit/10eb24cc91315481414fba0e0134209e6a9d7c94

从该commit的其他代码来看,支持reasoning和tool_use

简单分析代码得出:

GLM-4.5 是基于混合专家(MoE)结构的多模态可扩展大模型,具备高吞吐推理、结构化工具调用、可解释推理追踪、分布式负载均衡等特性。

支持多专家分组、负载均衡、分布式推理和多 token 预测(MTP)推理。

添加了新的推理解析器和工具调用解析器,允许模型输出严格的 … 推理内容和 <tool_call>…</tool_call> 工具调用内容,便于工具增强推理与函数调用。

文档显示 GLM-4.5 支持 T(文本)、I(图像)、E+(可扩展)、V+(视觉扩展),表明模型定位为多模态增强大模型。