|

前言 mcp 虽然让大模型有了访问外部工具的能力,从而大幅度拓展了大模型应用的能力边界,但是有的小伙伴会说:mcp 消耗的 token 太多啦!就算便宜如 deepseek,大规模任务在高峰时段调用一天,估计一杯蜜雪冰城就要没了。 那么有没有什么方法可以不用花钱也能使用 mcp 呢?有的兄弟有的。

神奇的浏览器插件:MCP-SuperAssistant今天要给大家隆重推荐的项目是 MCP-SuperAssistant,一款神奇的浏览器插件,它允许你在使用 deepseek, chatgpt 等等大模型的网页版本时也可以使用本地的 mcp。

github 仓库链接:

GitHub - srbhptl39/MCP-SuperAssistant: Brings MCP to ChatGPT, DeepSeek, Perplexity, Grok, Gemini, Google AI Studio, OpenRouter, DeepSeek, Kagi, T3 Chat and more...

我们都知道网页版本的大模型消耗 token 都是不花钱的,所以有了这个插件,我们就可以不花钱使用 mcp 了!

准备工作- chrome 浏览器

- 一个可以工作的 mcp

- nodejs 环境

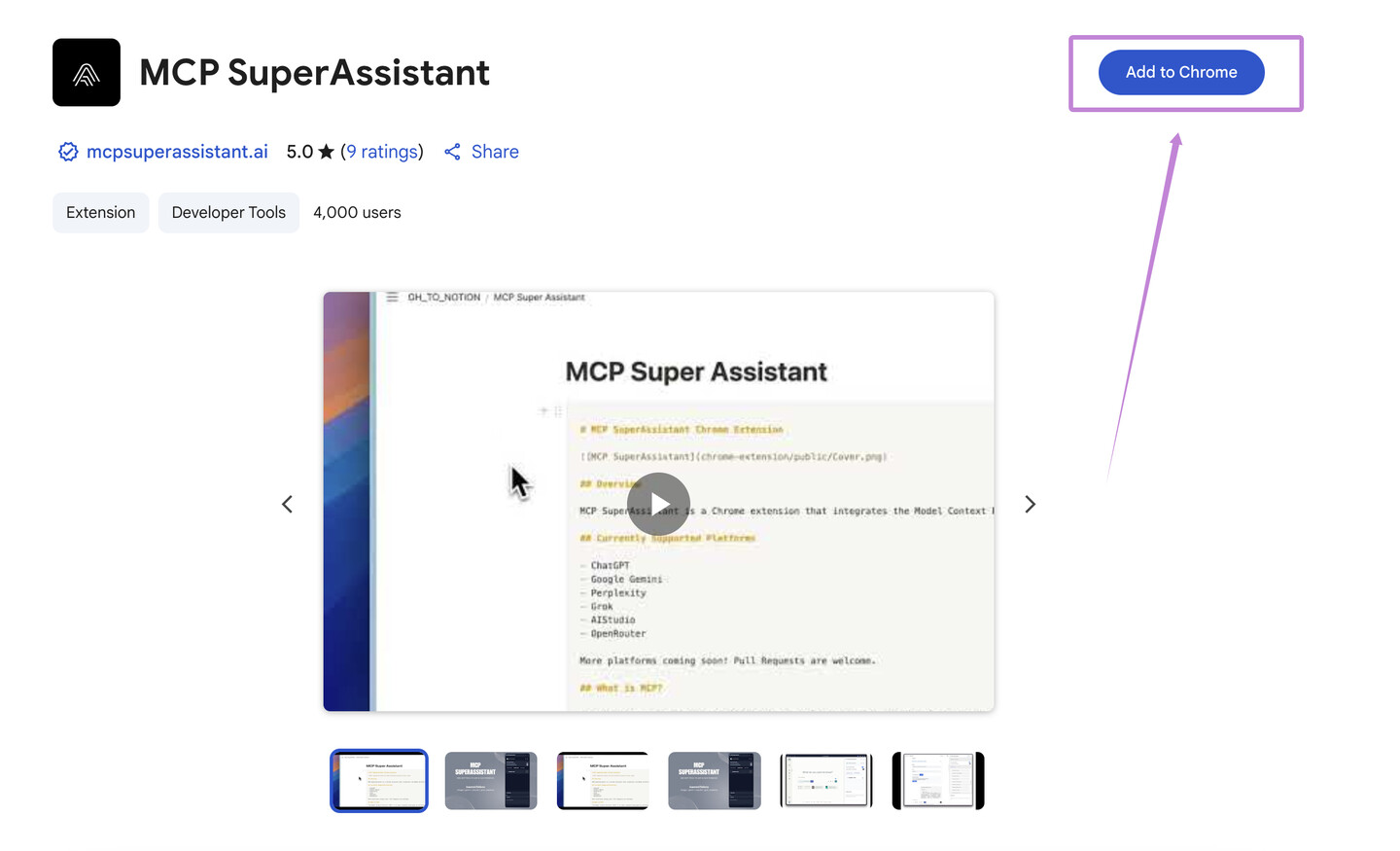

安装基本的环境安装完成 nodejs 后,我们需要先下载 MCP-SuperAssistant 这个 chrome 浏览器的插件,先点击 MCP SuperAssistant,Add to Chrome 就可以下载。

配置 MCPMCP SuperAssistant 通过插件和本地的代理来实现让浏览器也能访问 MCP,所以我们还需要配置一下本地的 MCP,让 MCP-SuperAssistant 知道我们本地需要连接哪些 MCP,每一个 MCP 如何进行连接。 首先我们需要有一个自己的 MCP,你可以选择从网上直接下载现成的 MCP 服务器,也可以针对自己的业务进行开发,这里安利一下我开发的用于进行 MCP 开发 vscode 插件 OpenMCP:

利用 OpenMCP,你可以直接在代码编辑器中就完成 MCP 的开发和验证与迭代,非常方便。 假设你已经获得了一个能用的 MCP 服务器,那么随便找一个目录,然后创建 mcpconfig.json,在 mcpconfig.json 中配置你的 MCP 服务器: - {

- "mcpServers": {

- "desktop-commander": {

- "command": "npx",

- "args": [

- "-y",

- "@wonderwhy-er/desktop-commander"

- ]

- },

- "neo4j-mcp": {

- "url": "http://localhost:8083/sse"

- }

- }

- }

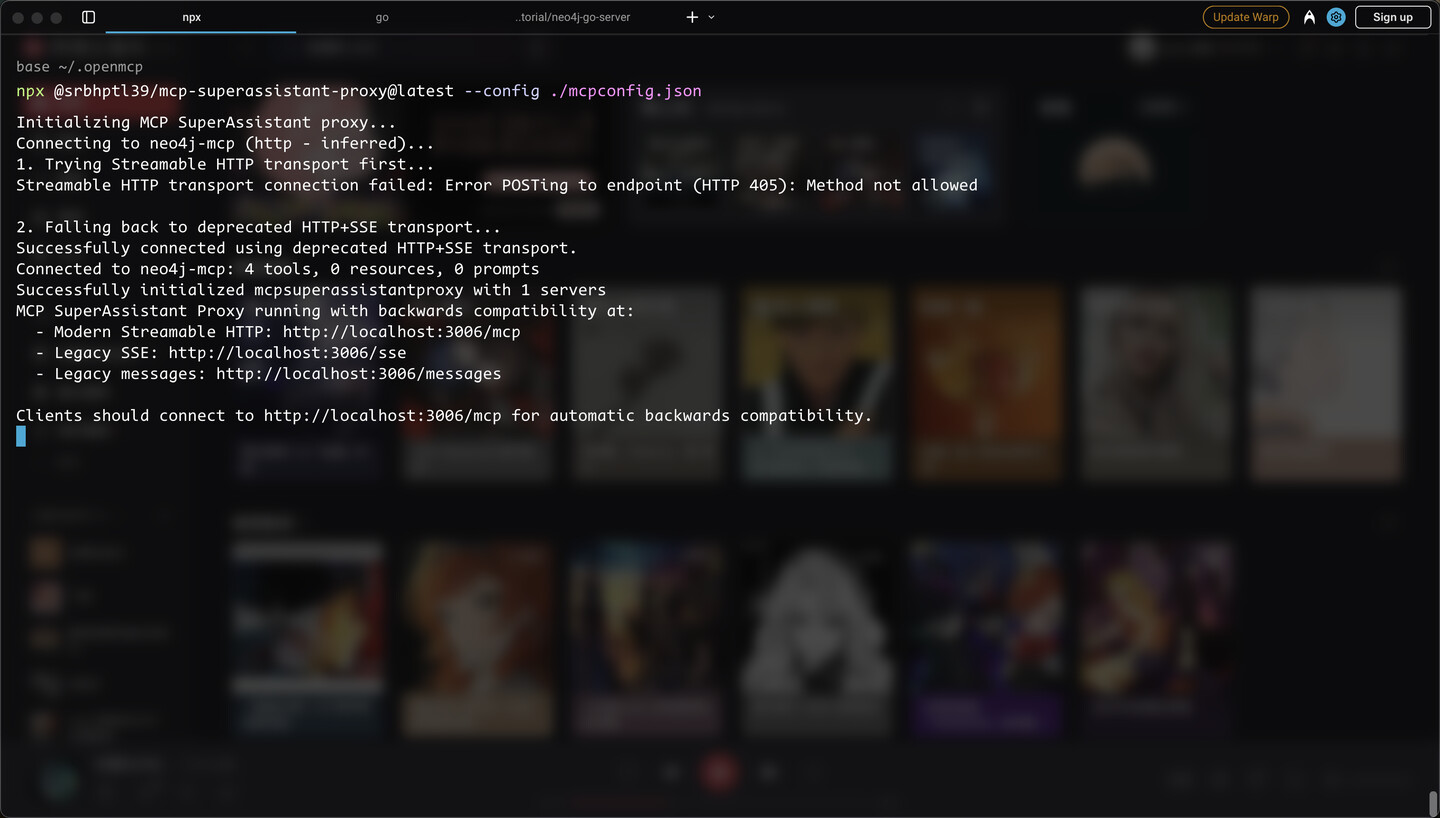

- npx @srbhptl39/mcp-superassistant-proxy@latest --config ./mcpconfig.json

此时,如果出现了下面这个样子的输出,说明运行成功。

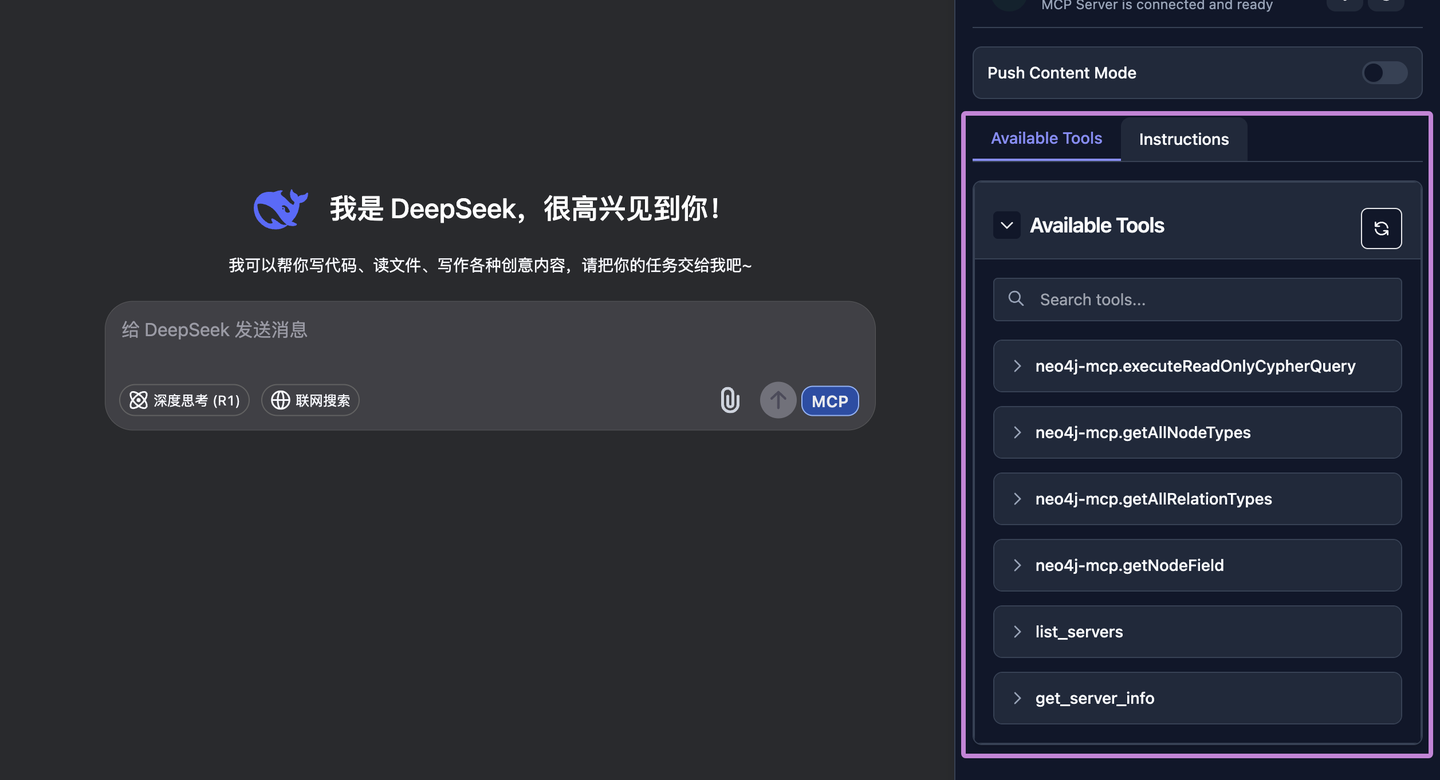

现在,我们进入 https://chat.deepseek.com/ ,新建一个对话(如果是已经开启 deepseek 网页的朋友记得刷新一下页面,来让插件得以激活)。此时,你应该可以看到输入框的右下角出现了一个小图标「MCP」,这代表插件激活成功。

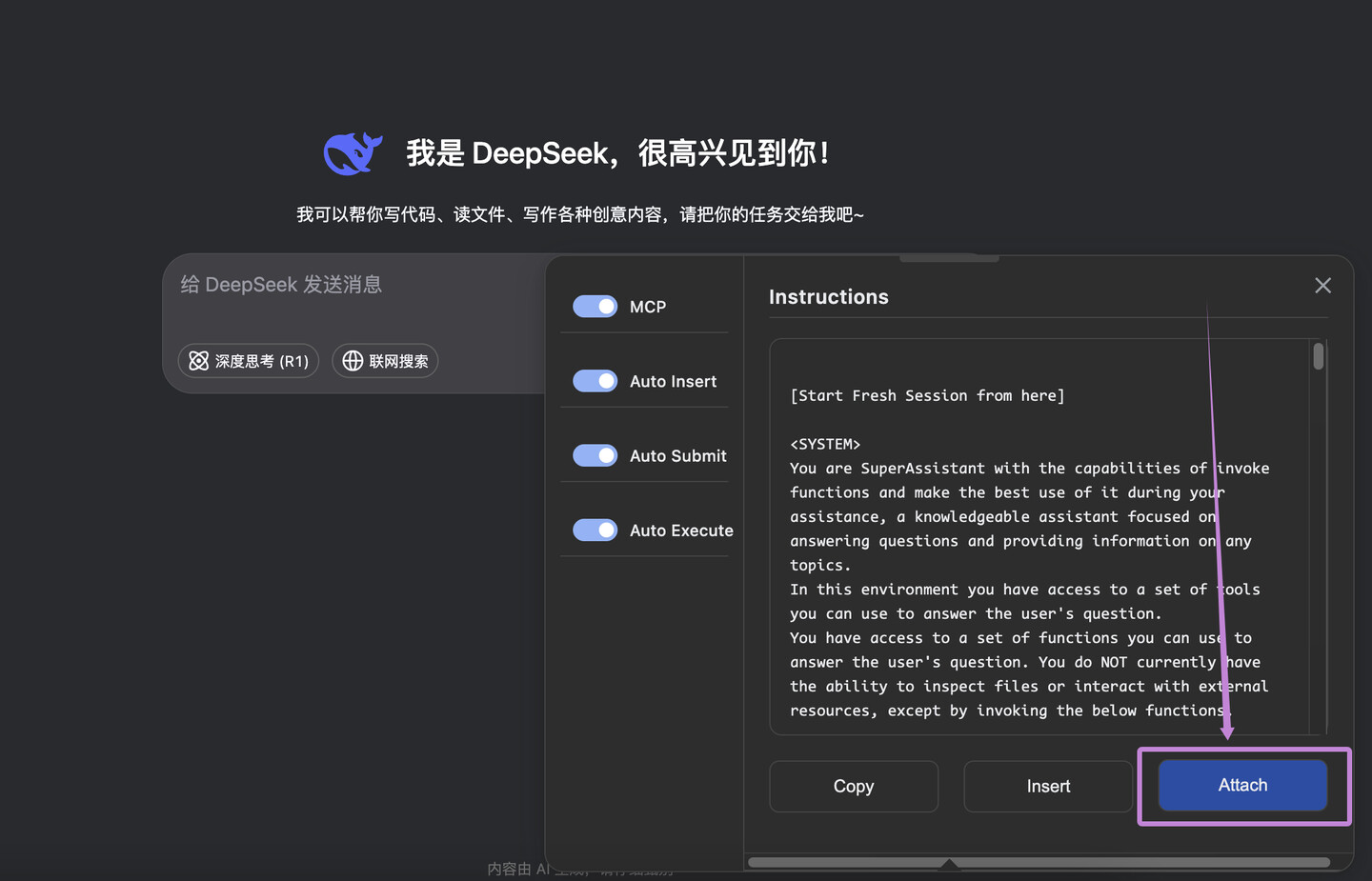

点击 「MCP」,将下面的这四个选项全部开启:

然后右侧会出现一个控制面板,检查一下面板内部是否存在你启动的 MCP 服务器对应的所有工具。如果存在,说明配置成功。

让大模型网页版本也可以使用 MCP如果你通过了上面的步骤,那么说明你已经成功配置了 MCP-SuperAssistant,接下来,我们就可以让大模型网页版本也可以使用 MCP 了。 这里有一个非常重要的点,一定要记好了:每一次新的对话,一定要先通过下面的操作来让大模型明白,它要如何使用 MCP,点击「MCP」「Attach」来粘贴起头的引导文本,这一步非常关键,没有这一步大模型是不会去进行工具调用的。

OK,接下来,我们就可以轻松愉快地让大模型进行 MCP 使用了。比如我的 MCP 是访问我的数据库的 MCP,我可以直接问大模型:

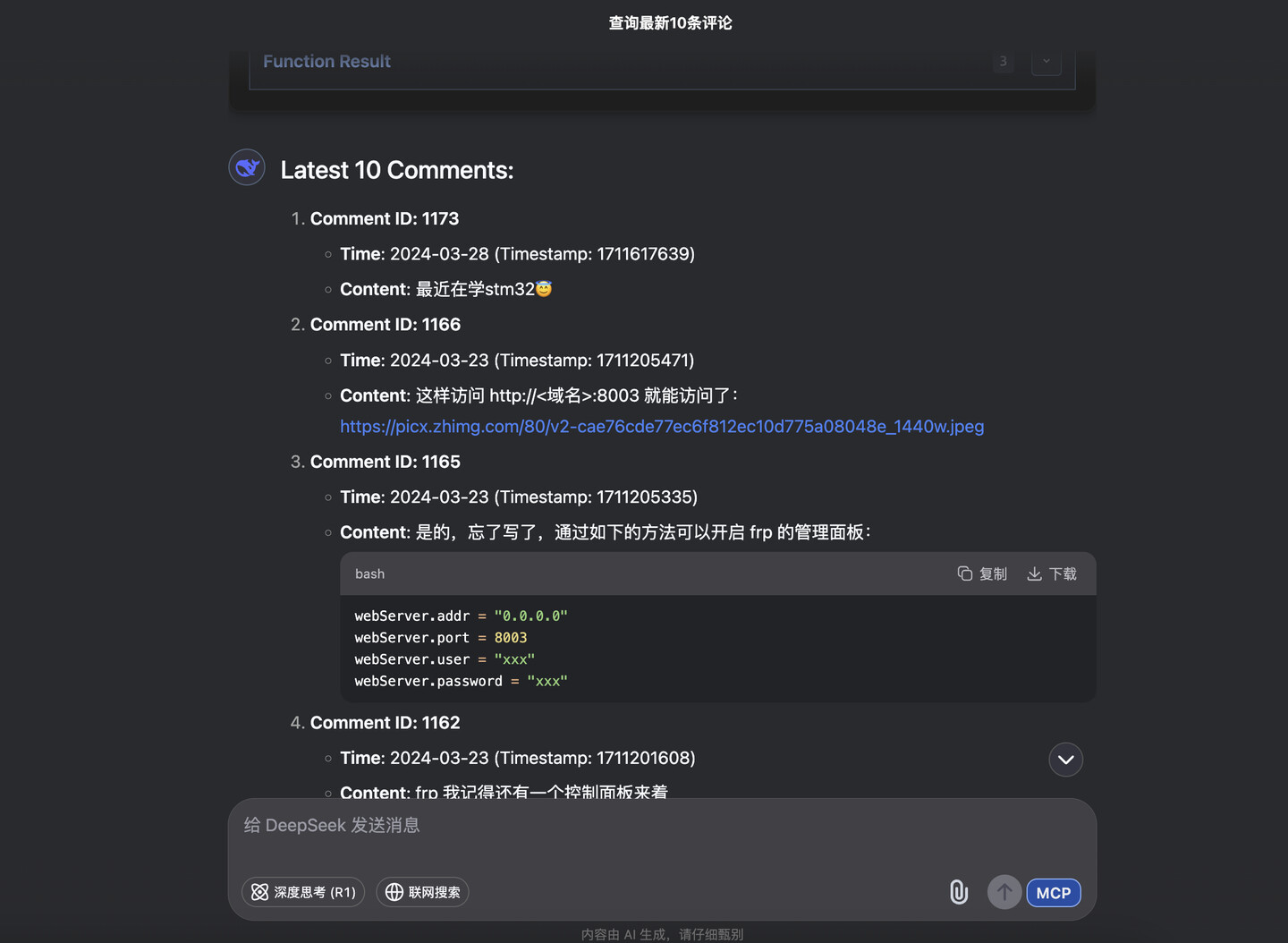

请告诉我最新的 10 条评论然后大模型就会自己思考,然后调用工具,获得结果,继续思考,调用工具,获得结果 … 经过若干步骤的迭代后,大模型输出了如下的结果:

|